Inhaltsverzeichnis

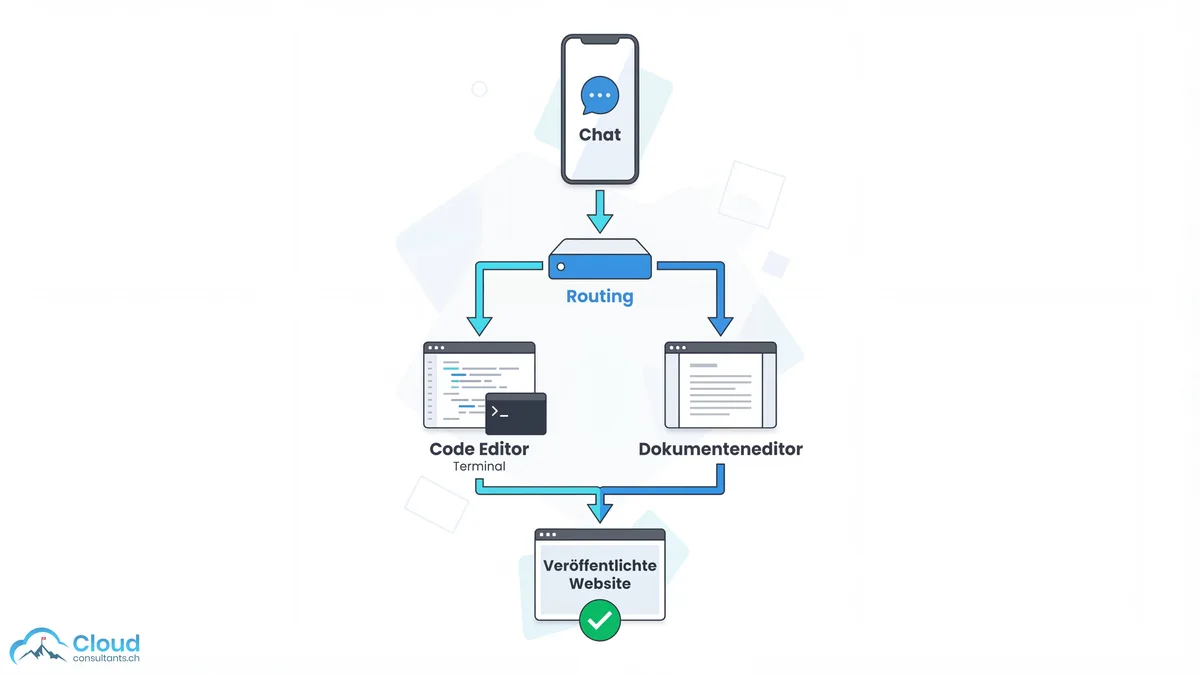

Claude Code Dispatch ist ein Routing-Mechanismus innerhalb von Claude Cowork, der eine Nachricht vom Mobiltelefon automatisch an den richtigen KI-Agenten weiterleitet — Coding-Aufgaben gehen an Claude Code Sessions, Wissensaufgaben an Cowork. Es ist der fehlende Link zwischen einer spontanen Idee und einem vollautomatisch ausgeführten mehrstufigen Workflow.

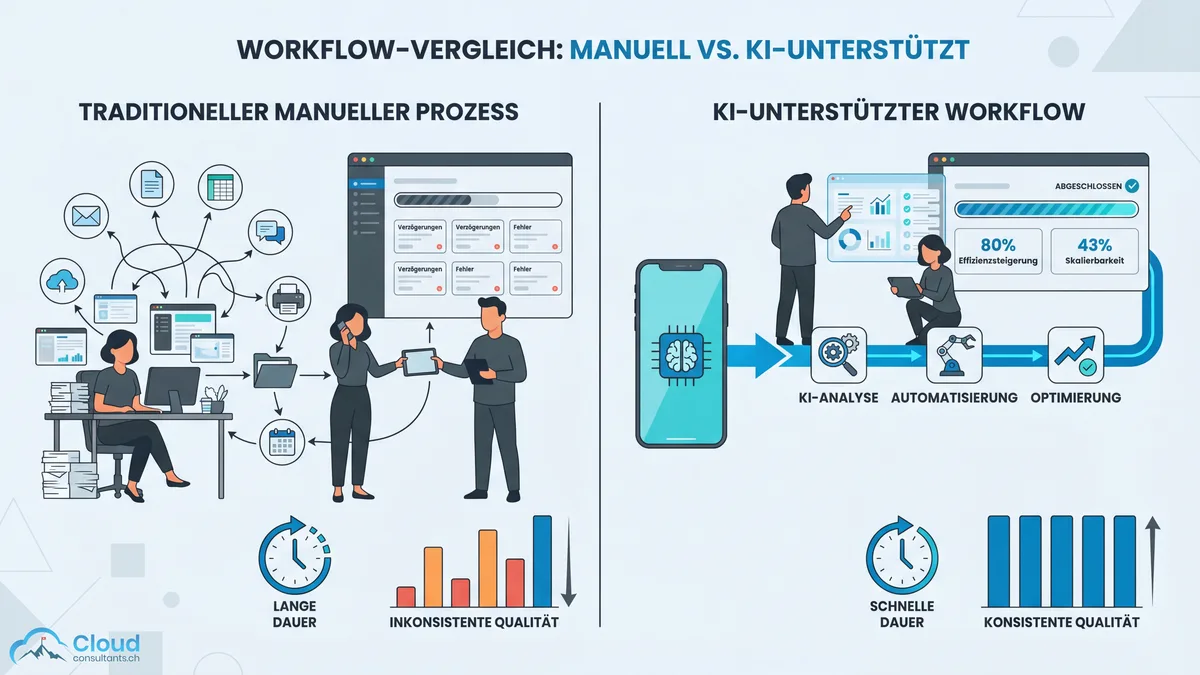

Content-Teams jonglieren heute zwischen Brief, Recherche, SEO-Check, Texterstellung, Bildproduktion und CMS-Upload — jeder Handoff kostet Zeit, erzeugt Inkonsistenzen und hängt an einzelnen Personen. Doch der eigentliche Engpass ist nicht die Ausführungsgeschwindigkeit, sondern die Reproduzierbarkeit: Dieselbe Qualität in jeder Session, mit jedem Mitarbeitenden, ohne dass jemand jeden Schritt begleiten muss. Claude Code Dispatch mit vordefinierten KI-Skills löst genau dieses Problem. Der Artikel, den Sie gerade lesen, wurde durch genau diesen Workflow erstellt.

Das Wichtigste in Kürze

- Dispatch als Routing-Layer: Nachrichten vom Mobiltelefon werden automatisch an Claude Code Sessions geroutet — Coding- und Content-Aufgaben laufen dann vollständig autonom ohne menschliche Zwischenschritte.

- Skills als Produktionspipeline: Wiederverwendbare SKILL.md-Dateien codieren komplexe Workflows — von Keyword-Recherche über Fact-Check bis zu Brand-konformen Bildern und automatischem Deploy.

- Reproduzierbare Qualität: Laut GitHub Research erledigen Entwickler Aufgaben mit KI-Unterstützung 55% schneller. Der eigentliche Hebel ist nicht das Modell — es ist die Engineering-Architektur dahinter.

Dieser Artikel zeigt die genaue Architektur des Dispatch-basierten Content-Workflows, beschreibt jeden Schritt anhand des Echtzeit-Beispiels dieser Session und bewertet, für wen dieser Ansatz tatsächlich sinnvoll ist. Wie wir dieselbe KI-Engineering-Architektur für einen kompletten Website-Relaunch mit 196 Seiten in 3 Tagen eingesetzt haben, zeigen wir in unserer Case Study zu Context Engineering und Website-Migration.

Was ist Claude Code Dispatch?

Claude Cowork wurde im Januar 2026 als Erweiterung von Claude Code eingeführt — gedacht für Wissensarbeit wie Dokumente, Recherche und strukturierte Entwürfe ausserhalb reiner Code-Aufgaben. Dispatch, das im März 2026 als Research Preview für Pro- und Max-Plan-Nutzer erschien, verbindet diese Welten.

Technisch schafft Dispatch einen persistenten Thread zwischen der Claude Mobile App und Claude Desktop. Der Mechanismus ist radikal einfach: Sie schreiben eine Nachricht auf Ihrem Telefon — und Dispatch entscheidet automatisch, an welchen Agenten die Aufgabe geht. Aufgaben, die Dateizugriff, Code oder Systemoperationen erfordern, landen in einer Claude Code Session. Reine Wissensaufgaben gehen an Cowork.

Das Entscheidende: Der Desktop-Rechner führt die Aufgabe autonom aus, während Sie die Nachricht längst wieder weggesteckt haben. Sie begleiten keine Zwischenschritte. Das Ergebnis wartet im Thread, wenn Sie zurückkehren.

Diese scheinbare Einfachheit verbirgt die eigentliche Komplexität auf der richtigen Seite — der Engineering-Seite. Nicht in der Nachrichtenbox, sondern in den CLAUDE.md-Dateien, den Skill-Pipelines und der CI/CD-Architektur dahinter.

Die technische Architektur — vom Mobiltelefon zur Live-URL

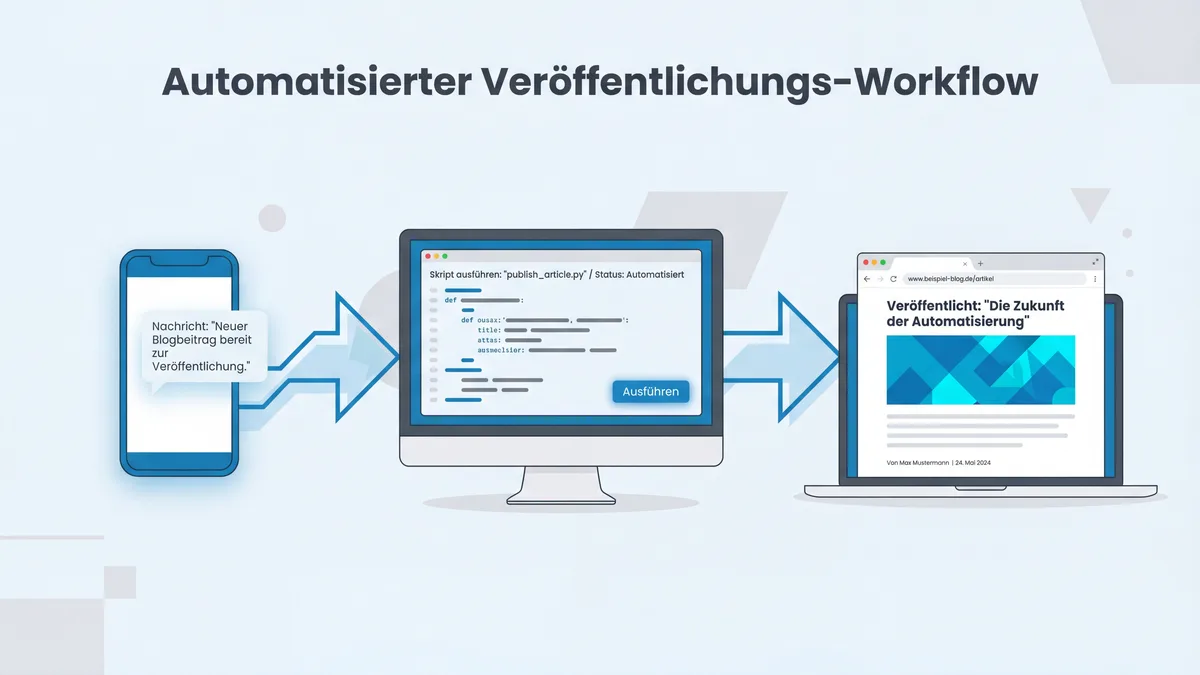

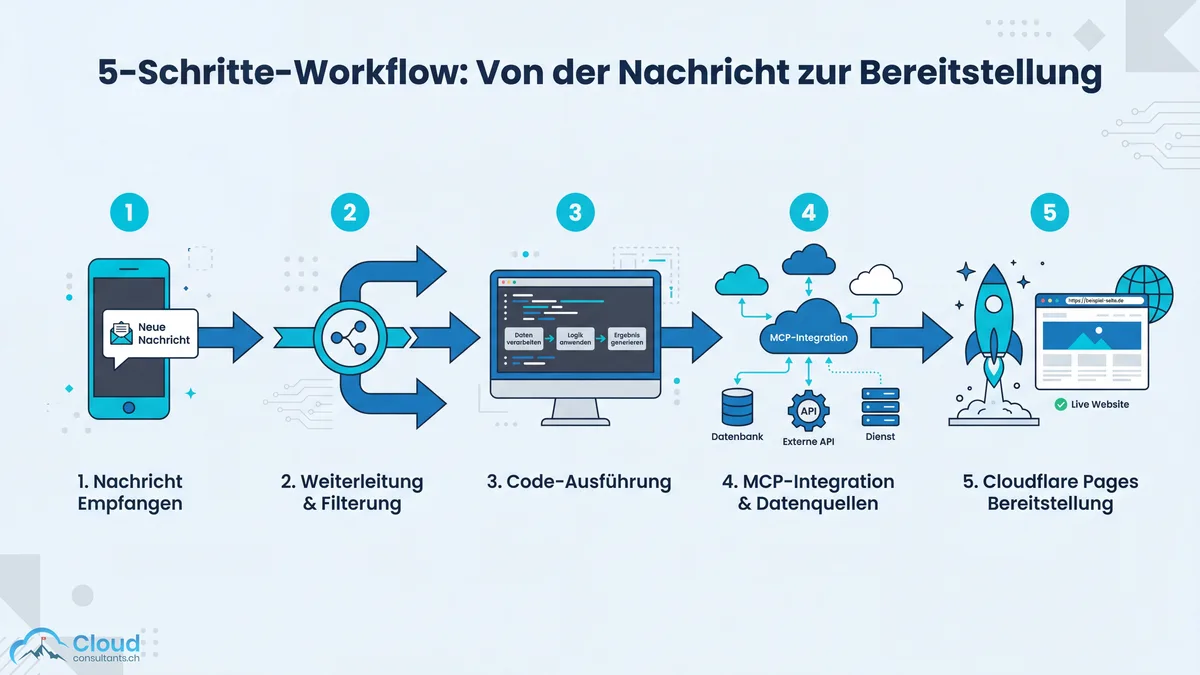

Für unseren Content-Publishing-Workflow sieht die vollständige Kette so aus:

Schicht 1 — Dispatch-Routing: Eine Nachricht auf dem Mobiltelefon landet via Dispatch in einer Claude Code Session, die in einem Git-Worktree des Website-Repositories geöffnet wird. Claude arbeitet auf einer isolierten Branch-Kopie — Änderungen beeinflussen main erst nach dem expliziten Push.

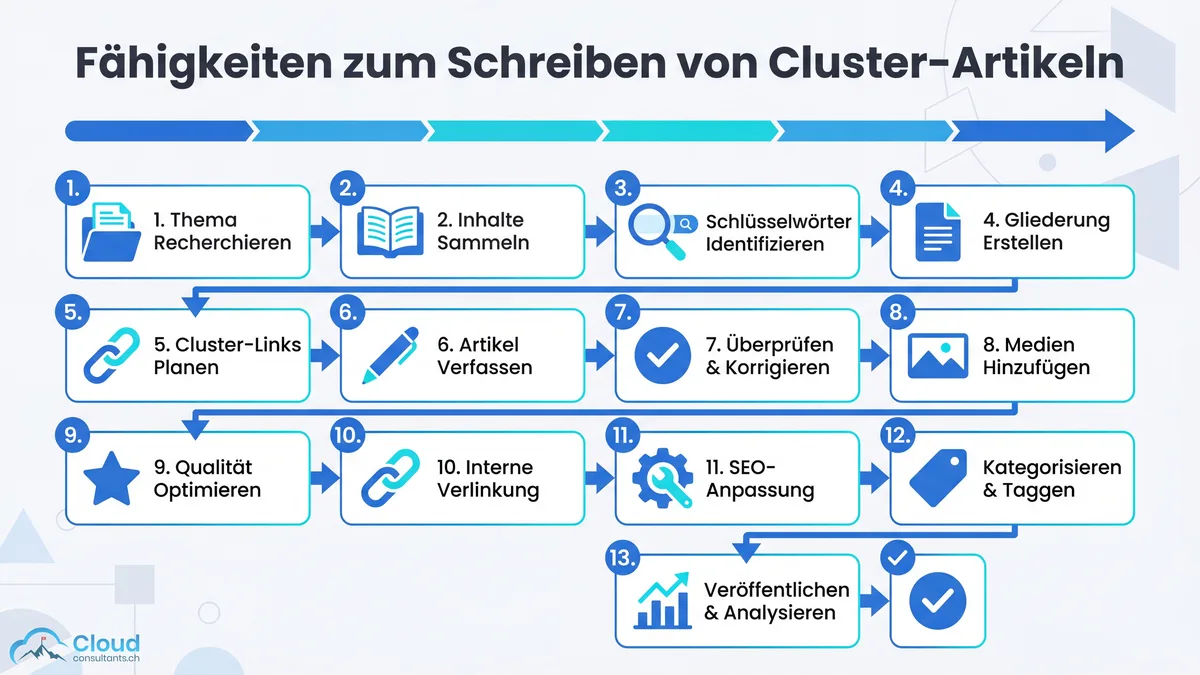

Schicht 2 — Kontext-Loading: Claude Code lädt automatisch CLAUDE.md (Projektregeln, Konventionen, Pfade) sowie alle relevanten Skill-Dateien aus .claude/skills/. In diesem Fall die write-cluster-article/SKILL.md — eine 13-Schritt-Pipeline, die für jede Session identisch ausgeführt wird.

Schicht 3 — Skill-Ausführung: Der Agent führt die Pipeline autonom aus. Er liest Brand-Dateien (tone-of-voice.md, icp.json, brand-system.md), erstellt bei Bedarf eine Cluster-Definition, startet einen Fact-Research-Subagenten und schreibt den Artikel ausschliesslich mit verifizierten Quellen.

Schicht 4 — MCP-Integrationen: Externe Tools werden direkt über das Model Context Protocol eingebunden. DataForSEO liefert Keyword-Daten. Google Search Console liefert aktuelle Ranking-Informationen. Die KI arbeitet mit Live-Daten — kein manuelles Kopieren, keine Screenshots.

Schicht 5 — CI/CD-Auslösung: Nach einem erfolgreichen pnpm build (zero Errors) wird ein Git-Commit erstellt und auf den main-Branch gepusht. Cloudflare Pages erkennt den Push und deployt automatisch. Die Live-URL ist innerhalb von Sekunden erreichbar.

Laut McKinsey erledigen Entwickler Coding-Aufgaben mit Generative AI bis zu doppelt so schnell. Für strukturierte, skill-gestützte Workflows — bei denen die KI nicht nur schreibt, sondern recherchiert, prüft, bebildert und deployt — ist das eine konservative Schätzung.

Der Workflow in der Praxis — diese Session als Echtzeit-Beispiel

Das hier ist kein konstruiertes Beispiel. Dieser Artikel wurde durch den exakt beschriebenen Workflow erstellt. Diese Session begann mit einer Dispatch-Nachricht, die den Artikel-Auftrag formulierte. Was dann passierte:

1. Cluster-Definition erstellt: Für den neuen Cluster ki-entwicklung wurde eine vollständige Cluster-Definition angelegt — mit Pillar-Seite, fünf Spoke-Artikeln, einer Link-Map und Content-Strategie-Notizen für den DACH-Markt.

2. Branding-Dateien gelesen: tone-of-voice.md, icp.json, brand-system.md — damit jede Formulierung zur Marke passt und auf die richtigen ICPs abzielt. Diese Dateien werden in jeder Session neu gelesen — kein veralteter Kontext aus früheren Sessions.

3. Fact-Research-Subagent gestartet: Ein separater Subagent hat 26 Web-Suchen und API-Aufrufe durchgeführt, um verifizierte Statistiken zu KI-Produktivität, Claude Code Features und DACH-Marktdaten zu sammeln. Das Ergebnis: ein Fact Sheet mit 20+ verifizierten Quellen. Die Subagenten-Architektur schützt das Hauptkontext-Fenster — alle Such-Ergebnisse bleiben im Subagenten-Kontext und belasten nicht die 200k Token des Hauptagenten.

4. Artikel geschrieben: Ausschliesslich mit Fakten aus dem Fact Sheet. Jede Statistik ist einer benannten Quelle zugeordnet und im Text verlinkt.

5. Fact-Check-Audit: Jede Zahl im Artikel wird gegen das Fact Sheet geprüft. Statistiken ohne verifizierten Ursprung werden durch qualitative Formulierungen ersetzt. Keine erfundenen Prozentzahlen.

6. Hero-Image und 4 Section-Images generiert: KI-generierte Illustrationen mit automatisch injiziertem Brand-Style-Prompt. Section-Images erhalten ein Logo-Overlay (bottom-left, 85% Opazität), Hero-Images nicht.

7. Build und Deploy: pnpm build ohne Errors. Git-Commit. Push auf main. Cloudflare Pages deployt automatisch — die URL geht live.

51% der professionellen Entwickler nutzen KI-Tools täglich, zeigt der Stack Overflow Developer Survey 2025 (49.000+ Befragte). Was noch vor zwei Jahren als Produktivitätshilfe galt, wird heute zur Produktionsinfrastruktur.

Skills als reproduzierbare Produktionspipeline

Der eigentliche Hebel dieses Systems sind nicht die KI-Modelle — Claude Opus 4.6 steht jedem zur Verfügung. Der Hebel sind die Skills.

Eine SKILL.md-Datei ist eine strukturierte Instruktionsdatei, die Claude wie ein Workflow-Skript ausführt. Unser write-cluster-article-Skill hat 13 Schritte — von der Cluster-Definition bis zum finalen Report. Jede Session führt exakt dieselbe Pipeline aus. Das bedeutet:

- Konsistente Brand-Voice in jedem Artikel, weil dieselben Branding-Dateien in jedem Durchlauf gelesen werden

- Zero fabricated statistics, weil der Fact-Check-Schritt strukturell im Workflow verankert ist und nicht übersprungen werden kann

- Automatische Interlinking-Architektur, weil der Skill die Cluster-Definition kennt und weiss, welche Sibling-Artikel verlinkt werden sollen

- Reproduzierbare Bildqualität, weil der Brand-Style-Prompt automatisch in jeden Image-Generator-Aufruf injiziert wird

GitHub Research hat in einer kontrollierten Studie mit 95 Entwicklern gemessen: Aufgaben werden mit KI-Unterstützung 55% schneller erledigt (1 Stunde 11 Minuten vs. 2 Stunden 41 Minuten, p=0.0017). 73% der Entwickler berichten, besser im Flow-State zu bleiben. Diese Zahlen gelten für Coding-Aufgaben — strukturierte Content-Workflows mit vordefinierter Pipeline erzielen vergleichbare Effekte.

Das ist der Unterschied zwischen „mit KI chatten” und „mit KI ingenieurmässig arbeiten”. Der erste Ansatz skaliert nicht. Der zweite produziert wöchentlich neue Artikel, jeden mit demselben Qualitätsstandard, ohne dass jemand jeden Schritt begleiten muss. Wie dieselbe Engineering-Disziplin in Salesforce-Projekten greift, beschreiben wir in unserem Artikel zur KI-gestützten Salesforce-Entwicklung.

Content-Velocity im DACH-Kontext

36% der deutschen Unternehmen setzen KI ein — das ist fast eine Verdopplung gegenüber dem Vorjahr, zeigt Bitkom Research 2025 (604 befragte Unternehmen ab 20 Mitarbeitenden). 81% sehen KI als die wichtigste Zukunftstechnologie. Der Übergang ist nicht mehr hypothetisch — er ist messbar.

Für Content-Teams bedeutet dieser Wandel eine konkrete Frage: Nicht „Soll KI den Artikel schreiben?”, sondern „Welche Engineering-Architektur stellt sicher, dass jeder KI-generierte Artikel brand-konform, faktengeprüft und SEO-optimiert ist?” Ein Dispatch-basierter Workflow mit strukturierten Skills beantwortet diese Frage.

Der Unterschied zur klassischen Redaktion ist nicht nur Geschwindigkeit. Es ist Konsistenz bei Skalierung. Ein menschliches Redaktionsteam, das zehn Artikel pro Woche produziert, hat Qualitätsschwankungen — unterschiedliche Autoren, unterschiedliche Recherche-Tiefe, unterschiedliche Einhaltung der Brand-Regeln. Ein skill-gestützter KI-Workflow liefert denselben Prozess in jeder Session. Nicht weil KI „besser” ist als Menschen, sondern weil der Prozess als Code definiert und damit wiederholbar ist.

Voraussetzungen und ehrliche Grenzen

Dieser Workflow ist nicht für alle Teams sofort einsatzbereit. Hier sind die Voraussetzungen und — wichtiger — die ehrlichen Grenzen:

Technische Infrastruktur (notwendig):

- Claude Pro oder Max Plan (Dispatch ist aktuell in der Research Preview)

- Claude Desktop auf einem Mac oder Windows-Rechner, der während der Ausführung aktiv bleiben muss

- Git-Repository mit Cloudflare Pages oder einem vergleichbaren Auto-Deploy-Service

- Vorbereitete CLAUDE.md-Projektdatei mit Projektstruktur, Konventionen und Pfaden

- SKILL.md-Dateien für jeden reproduzierbaren Workflow

Inhaltliche Infrastruktur (notwendig):

- Definierte Brand-Regeln in Dateiform (Tone of Voice, ICP, Brand System)

- Cluster-Definitionen für alle geplanten Themen

- Fact-Check-Prozesse, die sicherstellen, dass Statistiken vor Verwendung verifiziert werden

Was dieser Workflow nicht ersetzt: Strategische Entscheidungen über Themen und Prioritäten. Qualitätskontrolle bei fachlich komplexen Aussagen. Stack Overflow Developer Survey 2025 zeigt: Nur 29% der Entwickler vertrauen KI-Output ohne Überprüfung — eine gesunde Haltung, die auf Content-Workflows gleichermassen zutrifft. Der Workflow liefert einen verifizierten, brand-konformen Entwurf. Die finale Freigabe liegt beim Menschen.

Was dieser Workflow besonders gut kann: Cluster-basierte Content-Produktion, bei der dasselbe Format und dieselben Qualitätsregeln über viele Artikel hinweg konsequent eingehalten werden müssen. SEO-optimierte Artikel mit korrektem Interlinking, verifizierten Statistiken und strukturiertem FAQ-Schema — reproduzierbar, nicht nur einmalig.

Der Aufbau dieser Infrastruktur kostet Zeit — typischerweise mehrere Tage für ein vollständiges Content-System. Was danach entsteht, ist eine Produktionsmaschine, die diese Investition in den ersten Wochen zurückverdient.

Häufig gestellte Fragen

Was ist Claude Code Dispatch und wie funktioniert es?

Claude Code Dispatch ist eine Funktion innerhalb von Claude Cowork (seit März 2026 in der Research Preview für Pro- und Max-Plan-Nutzer), die es ermöglicht, Aufgaben per Mobiltelefon an einen persistenten KI-Agenten auf dem Desktop zu senden. Dispatch erstellt einen dauerhaften Thread zwischen der Claude Mobile App und Claude Desktop. Aufgaben werden automatisch geroutet — Coding-Aufgaben gehen an Claude Code Sessions, Wissensaufgaben an Cowork. Der Agent arbeitet autonom, während Sie anderes tun.

Wie lange dauert der Weg von der Idee zum veröffentlichten Artikel mit Claude Code Dispatch?

Bei einem strukturierten Workflow mit vorbereiteten Skill-Dateien, Brand-Regeln und einem bestehenden Git-Repository dauert der vollständige Prozess — von der Dispatch-Nachricht bis zum Live-Artikel auf Cloudflare Pages — typischerweise 30 bis 90 Minuten, je nach Artikelkomplexität. Die menschliche Arbeitszeit beschränkt sich auf die Aufgabendefinition (wenige Minuten) und optionale Qualitätskontrolle am Ende.

Was braucht man, um Claude Code Dispatch für Content-Publishing einzusetzen?

Technische Voraussetzungen sind ein Claude Pro oder Max Plan, Claude Desktop auf einem Mac oder Windows-Rechner, ein Git-Repository mit CI/CD-Pipeline (z.B. Cloudflare Pages), sowie vorbereitete SKILL.md-Dateien und eine CLAUDE.md-Projektdatei. Inhaltlich brauchen Sie definierte Brand-Regeln, Cluster-Definitionen und eine reproduzierbare Artikelstruktur.

Ist Claude Code Dispatch auch für technisch weniger versierte Teams geeignet?

Der initiale Setup-Aufwand ist erheblich — Git-Repository, CI/CD-Pipeline, CLAUDE.md und Skill-Dateien erfordern technisches Verständnis. Sobald das System aufgesetzt ist, kann es jedoch über einfache Textnachrichten ausgelöst werden. Der Agent übernimmt alle technischen Schritte autonom. Für Teams ohne Git-Workflow empfehlen wir, zuerst die technische Infrastruktur aufzubauen.

Was ist der Unterschied zwischen Claude Code Dispatch und einem normalen KI-Chatbot?

Ein normaler KI-Chatbot liefert Text-Antworten in einem Gesprächsfenster — der Mensch muss jeden Schritt manuell weiterführen. Claude Code Dispatch startet einen vollständig autonomen Agenten, der mehrstufige Aufgaben selbstständig ausführt: Dateien lesen, Code schreiben, externe APIs aufrufen, Bilder generieren, Git-Commits erstellen und den Build ausführen. Der Mensch definiert das Ziel; die KI führt alle Zwischenschritte aus.